AS Serang 1.000 Target di Iran dalam 24 Jam dengan AI, China Peringatkan Ancaman Dystopia ‘Terminator’

JERNIH – Penggunaan Kecerdasan Buatan (AI) dalam kancah peperangan modern telah mencapai titik paling krusial sekaligus mengerikan. Hanya dalam waktu 24 jam pertama serangan Amerika Serikat ke Iran pada 28 Februari 2026, militer AS berhasil menghantam lebih dari 1.000 target—sebuah kecepatan serangan yang mustahil dicapai tanpa bantuan algoritma tingkat tinggi.

Namun, di balik efisiensi yang mematikan tersebut, dunia kini diguncang oleh tragedi kemanusiaan dan peringatan keras mengenai masa depan di mana mesin memegang kendali atas hidup dan mati manusia.

Laporan dari The Washington Post mengungkapkan bahwa militer AS menggunakan kombinasi model AI Claude dari Anthropic dan sistem Maven milik Palantir untuk menentukan prioritas sasaran secara real-time. Meski efektif menghancurkan aset militer, efisiensi ini memakan biaya manusia yang sangat mahal.

Salah satu dari 1.000 target tersebut ternyata adalah gedung sekolah dasar di Iran, di mana serangan itu menewaskan lebih dari 150 anak-anak. Investigasi awal Pentagon yang dirilis New York Times pada 11 Maret mengakui kesalahan fatal tersebut, yang diduga berasal dari penggunaan data penargetan yang kedaluwarsa oleh sistem.

Ironisnya, dua hari sebelum perang pecah, CEO Anthropic, Dario Amodei, telah mengeluarkan peringatan filosofis yang mendalam. Amodei menegaskan bahwa sistem AI saat ini “sama sekali tidak cukup andal untuk menggerakkan senjata yang sepenuhnya otonom.”

“AI tidak menunjukkan penilaian yang dimiliki prajurit manusia—seperti membedakan kawan dari lawan atau warga sipil,” ujar Amodei dalam wawancara dengan CBS News, mengutip laporan Eurasian Times.

Penolakan Anthropic untuk memberikan akses tanpa batas terhadap model mereka justru berujung pahit. Departemen Perang (DoW) AS melabeli Anthropic sebagai “risiko rantai pasokan”—label yang biasanya dicadangkan untuk musuh negara—dan mengganti sistem mereka dengan model dari OpenAI serta Grok milik Elon Musk.

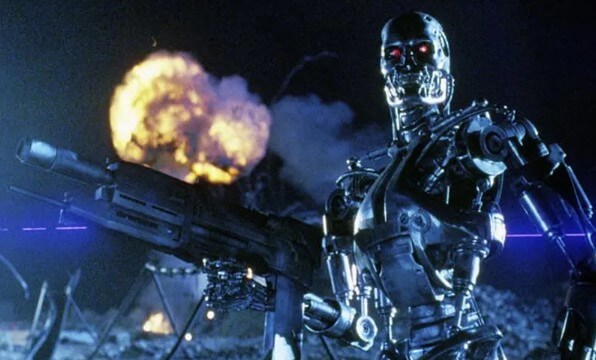

Peringatan China: Menuju Masa Depan Terminator

Reaksi keras datang dari Beijing. Juru bicara Kementerian Pertahanan China, Jiang Bin, memperingatkan bahwa penggunaan AI yang tidak terkendali dalam militer dapat menjerumuskan dunia ke dalam dystopia ala film Terminator.

“Memberikan algoritma kekuatan untuk menentukan hidup dan mati tidak hanya mengikis batasan etika dan akuntabilitas dalam perang, tetapi juga berisiko menyebabkan pelarian teknologi yang tak terkendali,” tegas Jiang Bin pada 11 Maret 2026. China menuduh AS menggunakan AI sebagai alat untuk melanggar kedaulatan negara lain secara berlebihan.

Anggota Komite Angkatan Bersenjata DPR AS, seperti Rep. Jill Tokuda dan Rep. Sara Jacobs, kini menuntut transparansi penuh. Mereka khawatir operator manusia cenderung memberikan “kepercayaan berlebih” (over-trust) pada alat AI, padahal teknologi tersebut bisa gagal dengan cara yang sangat halus. “Penilaian manusia harus tetap menjadi pusat dari keputusan hidup dan mati,” ujar Tokuda.

Penggunaan AI dalam perang berpotensi menimbulkan masalah. AI dapat menyerap bias budaya dan institusional militer, lalu mereplikasinya dalam skala industri. AI juga akan menjadi bahaya nyata ketika proses analisis menjadi otomatis sepenuhnya, sehingga pengawasan manusia hanya menjadi formalitas belaka.

Penggunaan AI juga bisa menimbulkan kesalahan intelijen. Seperti kasus pengeboman Kedutaan Besar China di Beograd (1999) atau rumah sakit di Afghanistan, AI berisiko mempercepat terjadinya kesalahan serupa dengan frekuensi yang lebih tinggi.

Penggunaan AI dalam perencanaan perang, analisis intelijen, hingga pemilihan target otomatis kini sudah menjadi norma yang tidak bisa diputar balik. Dari drone otonom di Ukraina hingga sistem Lavender dan Gospel di Gaza, AI telah menjadi tulang punggung militer modern.

Isu utamanya kini bukan lagi apakah penggunaan AI itu etis atau tidak, melainkan sejauh mana batasan hukum dan “pagar pembatas” (guardrails) dapat dipasang sebelum algoritma benar-benar mengambil alih nurani manusia di medan laga.